Es ist eine dieser Geschichten, die fast banal klingen, bis man den Mechanismus dahinter versteht: Meta braucht immer mehr Daten für seine KI, und plötzlich wird nicht nur das Verhalten von Milliarden Nutzerinnen und Nutzern zum Rohstoff, sondern auch die Arbeit von Menschen, die bei Facebook, Instagram und WhatsApp Inhalte prüfen, moderieren und organisieren. Ausgerechnet jene, die das System am Laufen halten, geraten nun selbst in die Verwertungslogik hinein.

Der Kontext ist bekannt, aber die Geschwindigkeit ist bemerkenswert. Meta investiert seit Jahren massiv in KI-Infrastruktur. Im Quartalsbericht zum 1. Quartal 2024 meldete der Konzern 36,5 Milliarden US-Dollar Umsatz und kündigte Investitionen in Höhe von 35 bis 40 Milliarden US-Dollar für das Gesamtjahr an. Ein großer Teil davon fließt in Rechenzentren, Chips und Datenpipelines. Das ist kein Nebenschauplatz, sondern das eigentliche Geschäftsmodell der nächsten Phase: Wer die Modelle trainiert, kontrolliert die Schnittstelle zwischen Aufmerksamkeit, Werbung und Automatisierung.

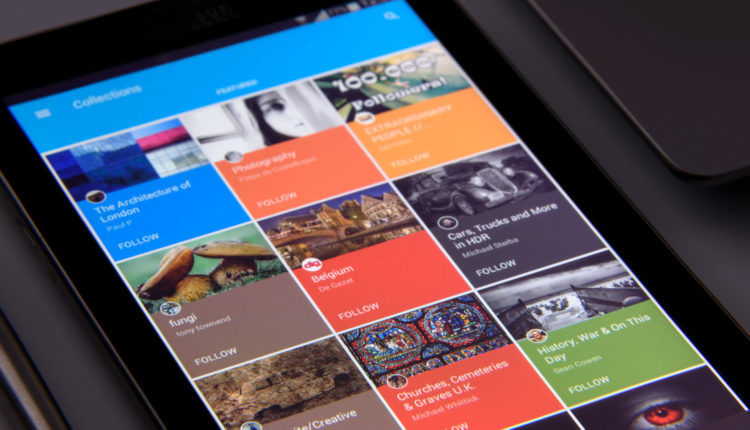

Neu ist dabei weniger, dass Plattformen Daten sammeln. Neu ist die Reichweite des Zugriffs. Meta hat 2024 angekündigt, öffentliche Inhalte von Erwachsenen auf Facebook und Instagram für das Training seiner KI-Systeme zu nutzen, unter anderem Posts, Kommentare, Fotos und Bildunterschriften. In der europäischen Debatte war das so brisant, weil es die alte Trennung zwischen Nutzung einer Plattform und Verwertung ihrer Inhalte weiter auflöst. Wer online etwas öffentlich sagt, liefert nicht nur Reichweite für Anzeigen, sondern auch Trainingsmaterial für Systeme, die später genau diese Kommunikation automatisieren sollen. Der Mensch wird nicht mehr bloß Nutzer, sondern Zulieferer.

Und genau hier wird es systemisch. Denn die viel größere Zumutung betrifft nicht nur die Öffentlichkeit, sondern die Beschäftigten selbst. Content-Moderatorinnen und -Moderatoren, Vertrauens- und Sicherheitsteams, Produktanalysten, Datenlabeler, interne Prüfer: Ihre Arbeit erzeugt die Ordnung, auf der KI überhaupt brauchbar wird. Sie entscheiden, was gelöscht, markiert, priorisiert oder als problematisch erkannt wird. Das ist unsichtbare Infrastrukturarbeit. Sie ist schlecht bezahlt, psychisch belastend und für das Unternehmen hoch strategisch. Wer sie leistet, ermöglicht nicht nur das Werbegeschäft, sondern auch die Qualität der KI-Modelle. Das klingt abstrakt, ist aber knallhart ökonomisch: Ohne menschliche Vorarbeit bleibt generative KI eine ziemlich teure Plaudermaschine.

Ein oft übersehener Punkt ist dabei unbequem: Die Qualität moderner KI steigt nicht einfach durch mehr Daten, sondern durch besser kuratierte, besser bewertete und besser sauber gemachte Daten. Genau dafür braucht Meta Menschen. Nicht als romantische Co-Autoren, sondern als industrielle Fehlerkorrektur. Das verschiebt die Machtfrage. Die Rendite entsteht oben, die Unsicherheit bleibt unten. Ironischerweise wird also gerade jene menschliche Tätigkeit, die KI angeblich irgendwann ersetzt, im Moment besonders intensiv ausgebeutet, um diese Ersetzung vorzubereiten. Ein eleganter Kreislauf. Nur leider nicht für die Beschäftigten.

Es gibt allerdings eine faire Gegenposition. Meta argumentiert, dass öffentliche Inhalte schon immer Teil digitaler Öffentlichkeit waren und dass KI-Training ohne große, vielfältige Datensätze kaum konkurrenzfähig möglich sei. Das stimmt in einem engen technischen Sinn. Auch die akademische Literatur zu großen Sprachmodellen macht deutlich, dass Modellleistung stark von Datenmenge, Datenvielfalt und Datenqualität abhängt. Wer das ernst nimmt, muss zugeben: Ein europäisch kastrierter oder technisch künstlich verarmter Datensatz würde die Systeme tatsächlich schwächen. Die Frage ist also nicht, ob Daten für KI gebraucht werden. Die Frage ist, wer darüber verfügt, unter welchen Regeln, und wer den Wert abschöpft.

Und genau da kippt die Debatte. Denn öffentlich bedeutet in einer Plattformökonomie nicht automatisch frei verfügbar für jede spätere Verwertung. Öffentlich heißt oft nur: zugänglich unter den Bedingungen eines Unternehmens, das die Spielregeln jederzeit ändern kann. In der Praxis entsteht dadurch ein asymmetrisches Tauschverhältnis. Nutzerinnen und Nutzer bekommen Reichweite, Bequemlichkeit und eine kostenlose App. Meta bekommt Verhaltensdaten, Trainingsmaterial und die Möglichkeit, die nächste Technologiewelle zu monetarisieren. Das ist nicht illegal per se. Aber es ist ein bemerkenswert guter Deal für genau eine Seite.

Besonders heikel wird es, wenn man die Arbeitsseite mitdenkt. Die Angestellten von Facebook, Instagram und Co. sind nicht einfach Angestellte eines Tech-Konzerns. Sie sind Teil einer Datenmaschine, die Menschen draußen und drinnen in Material verwandelt: draußen in Inhalte, drinnen in Qualitätsarbeit, die kaum sichtbar ist und selten den öffentlichen Ruhm der KI-Frontstage bekommt. Die Plattform verkauft Innovation, aber sie lebt von einer sehr alten Logik: externe Effekte auslagern, Wert zentralisieren. Moderationsstress, Prekarität und Datenschutzkonflikte bleiben fragmentiert; der Gewinn wird bilanziert.

Genau deshalb ist Metas aktuelle Strategie mehr als nur ein neuer KI-Schritt. Sie zeigt, wohin die digitale Ökonomie driftet: weg von der Illusion, Technologie sei ein neutraler Fortschritt, hin zu einer Infrastruktur, die menschliche Kommunikation doppelt abschöpft. Zuerst als Datenquelle, dann als Trainingsmaterial, schließlich als Markt, auf dem das daraus entstehende System wieder verkauft wird. Das ist wirtschaftlich effizient. Demokratisch ist es eher unerquicklich.

Die unbequeme Schlussfolgerung lautet deshalb: Solange Plattformen wie Meta ihre Macht über Daten, Arbeitskraft und Modelle gleichzeitig ausweiten dürfen, ist der Mensch nicht Kunde und auch nicht nur Nutzer, sondern zunehmend Rohstoff. Und wer das für einen normalen Preis der Innovation hält, sollte sich nicht wundern, wenn am Ende nicht die KI die Menschen ersetzt, sondern nur die Ausrede, warum alles immer noch so billig wie möglich für den Konzern bleiben muss.

Weiterführende Links

- Meta Q1 2024 Results

- Meta announces new options for how Facebook and Instagram can use public content for AI training in the EU

- European Data Protection Board response to Meta AI training